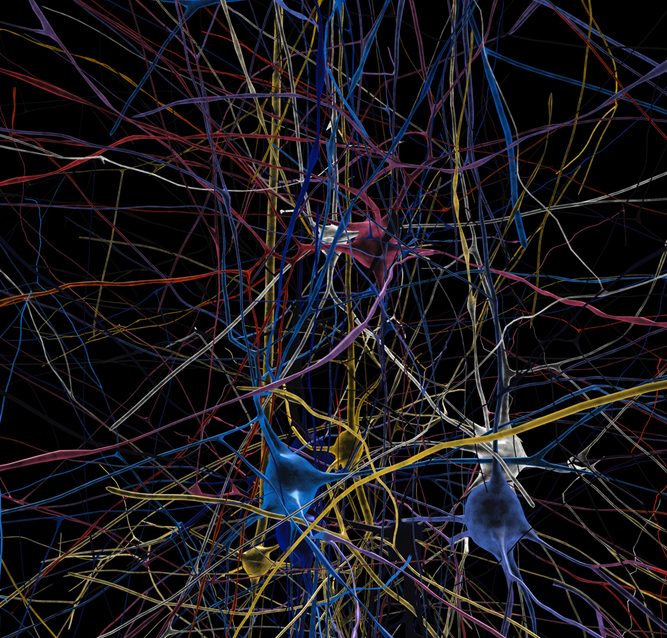

خودآگاهی مصنوعی آدمکهای ماشینی یا نرمافزارهای پیشرفتهای که «هوشیار شده»اند از آن دست ایدههای سینماییست که خواه ناخواه بحثهای مهمی را پیش میکشد.

به واقع امر، راه دستیابی به خودآگاهی مصنوعی را نمیدانیم حتی اگر هم یکی خلق میکردیم نمیدانستیم (با فناوریهای سنجش امروزی)، که اکنون تمام این عدمقطعیتها نیز ما را در موقعیت متزلزلی قرار داده است. در همین هنگام، چنین موضوعی امر بسیار مهمی را نیز به پیش میکشد، چرا که وجود دستگاههای خودآگاه پدیدآور پیآمدهای دراماتیک و اخلاقی نیز خواهند بود.

ما مستقیماً نمیتوانیم رد آن خود-آگاهیای را بزنیم که در رایانهها و نرمافزار آنها اجرا میشود: دستکم، نه بیشتر از چیزیکه میتوانیم از قورباغهها و حشرات بفهمیم! بله، ما نور را تشخیص میدهیم اما برای اندازهگیری صورتهای نامرئی نورــ همچون امواج ایکس-ریــ نیاز به چشم مسلح داریم.

حتی چنین درکی به علت وجود نظریهی الکترومغناطیسم است که به کاراییاش اطمینان داریم و قادریم ابزارهایی بر اساس این نظریه توسعه دهیم که بتواند چیزهایی را حس کند که حواسمان نمیتوانند. همین موضوع را بسط دهید به توسعهی نظریهی مناسب خودآگاهی که معیار سنجش هوشیاری را فراهم میکند تا برای تعیین آن «چیزی» که قادر به تکلم نیست، بتوانیم پی ببریم که، آن چیز بر اساس کارایی و سرشتش، خودآگاه هست یا نیست.

بیشتر بخوانید: خودآگاهی هوش مصنوعی GPT-3 به مرحلهای رسیده که درباره خودش مقاله مینویسد

توسعهی خودآگاهی مصنوعی

بدبختانه، اجماعی بر سر نظریهی خودآگاهی وجود ندارد چه برسد بر خودآگاهی مصنوعی. برآورد اخیری که پژوهشگران «هوشیاری» انجام دادهاند نشان داد که فقط 58 درصد از آنها به متداولترین نظریه، یعنی فضایکاری جهانی (که میگوید، افکار آگاهانهیِ انسان، در دیگر فرآیندهای ناآگاهانه مغزش توزیع شده است)، امیدوار بودند.

سه نظریهی برتر متداول آگاهی، شامل فضای کاری جهانی، از اساس، در چگونگی و یا اینکه تحت چه شرایطی هوشیاری رایانهها میتواند رقم بخورد اختلاف نظر دارند.

به ویژهکه این فقدانِ توافق سد مهمی را هم به وجود آورده؛ چرا که هر سنجشی از خودآگاهی موجود در ماشین یا حیوانات غیر انسان بستگی به یک نظریه و یا دیگر نظریهها دارد. در این وادی، هیچ راه مستقلی برای آزمودن آگاهی یک هستومند بدون التفات بر یک نظریه وجود ندارد.

اگر ما به این عدم قطعیت در میان حرفهایهای این رشته توجه کنیم، میبینیم که راه منطقی، اندیشیدن دربارهی وضعیت بسیار تاریکیست که رایانهها چگونه میتوانند خودآگاه شوند (ساحتی که چیزی از آن نمیدانیم!)ــ و اگر میتوانند چگونه میتوانیم به این امر دست بیابیم. بسته به آنچهکه نظریهها در اختیارمان قرار میدهند تنها سه احتمال وجود دارد (در فرض): هیچگاه رایانهها خودآگاه نخواهند شد، ممکن است روزی بشوند و یا بعضیهاشان هماکنون هستند!

در این اثنا، عدهی کمی از افراد هستند که به جد میکوشند دستگاهها و یا نرمافزاری هوشمند بسازند. دلیلش این است که عموماً ساحت هوشمصنوعی کوشیده ابزارهای سودمند بسازد و هیچ دلیل روشنی در دست نداریم که آگاهی ماشین میتواند در کارهاییکه ما از رایانهها میخواهیم کمکی بکند!

فراسوی خیر و شر با خودآگاهی مصنوعی

اخلاق نیز همچون خودآگاهی پر است از عدم قطعیت و فقدان اجماع بر سر اصول. حتّی پس از گذشت هزاران سالی که به روی آن کار شده است. اما یک حس (نه تفکری جهان شمول) گمان میکند که خودآگاهی اندرکنش مهمی با اخلاق دارد.

علیالخصوص، اغلب پژوهشگران، با التفات به هر نظریهی اخلاقی که تاییدش کنند، باور دارند که توانایی تجربهی امر مطلوب و یا نامطلوب یکی از ویژگیهای مهم حالات آگاهانهست که یک هستومند را شایستهی توجّه اخلاقی میکند.

همان چیزی که زدن سگ را اشتباه میداند ولی صندلی را خیر. اگر ما رایانههایی بسازیمکه بتوانند حالات مثبت و منفی آگاهانه را تجربه کنند، چه الزامات اخلاقیای را برابر آنها خواهیم داشت؟ شاید ما بهتر است با رایانه و یا تکه نرمافزاری که توانایی درک شعف یا رنج را دارد با ملاحظات اخلاقی رفتار کنیم.

ما آدمکهای ماشینی و یا دیگر مصنوعیجات هوشمند را میسازیم که کارهایی که قادر به انجامشان نیستیم انجام دهند، و هم کاری که دلمان نخواهد انجامش دهیم. بنابر این، به اندازهای که این هوشهای مصنوعی دارای خودآگاهیای نظیر ذهن ما باشند، سزاوار توجّه اخلاقی مشابه ما هستند.

البته، فقط به دلیلاینکه یک هوش مصنوعی خودآگاه است به معنای این نیست که آنها ترجیحاتی مشابه ما و یا ارزشهای نامطلوب یکسانی داشته باشند امّا ترجیحاتشان هر چه که باشد، در هنگام راهاندازی هوم (هوشمصنوعی) باید به دقّت در نظر گرفته شوند. ساخت دستگاه هوشیاری که به کاری واداردش کنیم از نظر اخلاقی مشکلساز است. این بسیار واضح به نظر میرسد؛ امّا مشکلات ژرفتری در این میان وجود دارد.

سه سطح در هوش مصنوعی را تصوّر کنید. آدمک ماشینی یا رایانهای وجود دارد که ـــ بر هر کدام از آنها میتوان نرمافزاری اجرا کرد. سپس، کدی بهروی یکی از سختافزارها نصب میشود. در نهایت، در ازای هرباریکه این کد بارگذاری شده، ما یک «نمونه» کد اجرا شده داریم.

در چه سطحی از این فرآیندی که اجرا شده، ما با اخلاقیات رویاروی میشویم؟ محتمل است که سطح سختافزار و کُد غیر معقول باشند و عامل هوشمند در نمونهکدی باشد که در حال اجراست! یعنی، اگر شخصی به روی رایانهاش نمونه نرمافزار خودآگاهی اجرا کند از نظر اخلاقی موظفیم که تا ابد آن را در حالت اجرا نگه داریم؟

مضاف بر آن، خلق هر نرمافزاری به بارها عملیات رفع خطا برای کارایی درست و رفع مشکلات نیاز دارد. چه میشود اگر یک شخص از منظر اخلاقی ملتزم به نگهداری «نمونه» نرمافزار خودآگاه در فرآیند توسعه باشد؟ این امر گریز ناپذیر است: مدلسازی رایانهای یک راه با ارزش برای کشف و آزمودن نظریهها در روانشناسیست. در نظر گیری اخلاقیات در نرمافزار خودآگاه به سرعت میتواند تبدیل به معضلی محاسباتی و انرژیک شود که هیچ نتیجهی واضحی هم در پی ندارد.

آیا باید از ساخت خودآگاهی مصنوعی اجتناب کنیم؟

حال میخواهم به اصل ماجرا برگردم. اگر یک ماشین هم دارای خودآگاهی مصنوعی باشد و هم تجربیات مثبت، آنگاه در ساحت اخلاق، دارای سطحی از رفاه میشود و راهاندازی چونین ماشینهایی به نوعی میتواند مولّد رفاه نیز باشد. در حقیقت، ماشینها حتّی کارآمدتر از موجودات زیستشناختی قادر به تولید سعادتی نظیر شادی و شعف هستند. که این یعنی، به ازای هر مقدار منابعی که در اختیار دارند میتوانند بیشتر از موجودات زنده شادی و شعف تولید کنند.

به گمانی برای مثال، آیندهی فناوری به ما اجازهی ساخت رایانههایی کوچکی دهد که از انسانهای سرخوش، خوشترند. امّا فقط نیاز به انرژیای در حد و اندازهی یک لامپ دارند! در این نمونه، بر اساس موازین اخلاقی، بهترین سلسله اقدماتی که بشر میتواند انجام دهد، تا جای ممکن ساخت رفاه مصنوعی، چه در حیوانات، انسانها و یا رایانهها خواهد بود.

هدف انسانهای آینده شاید تبدیل تمام مادهی در دسترس جهان به شکل ماشینهایی دارای خودآگاهی مصنوعی باشد که قادر به تولید رفاه تا دههزار برابر بیشتر از هر موجود زندهای هستند؛ چیز عجیبیکه شاید آیندهای با بیشترین سعادت را در پی داشته باشد.

بیشتر بخوانید:

- هوش مصنوعی به کمک توسعه شبکه برق چین میآید؛ رفع خاموشیها در عرض 3 ثانیه

- شال گردن هوشمند منچستر سیتی وضعیت احساسی تماشاگران را تحلیل میکند

- آسمان خراش 120 کیلومتری افقی عربستان سعودی با سرمایه 1 تریلیون دلاری ساخته میشود

- قلم لیزری جدید و نمایش متون در هوا ؛ ابتکار جدیدی از دانشمندان چینی!

دیدگاه شما دربارهٔ خودآگاهی مصنوعی چیست؟ نظرات خود را در بخش کامنتها با ما در میان گذاشته و اخبار تکنولوژی را از تکراتو دنبال کنید.

منبع: ScientificAmerican

زدن دکمه مرگش سخت خواهد بود شاید اون هم برای از دست ندادن جان مصنوعی خودش دست به هر کاری بزنه